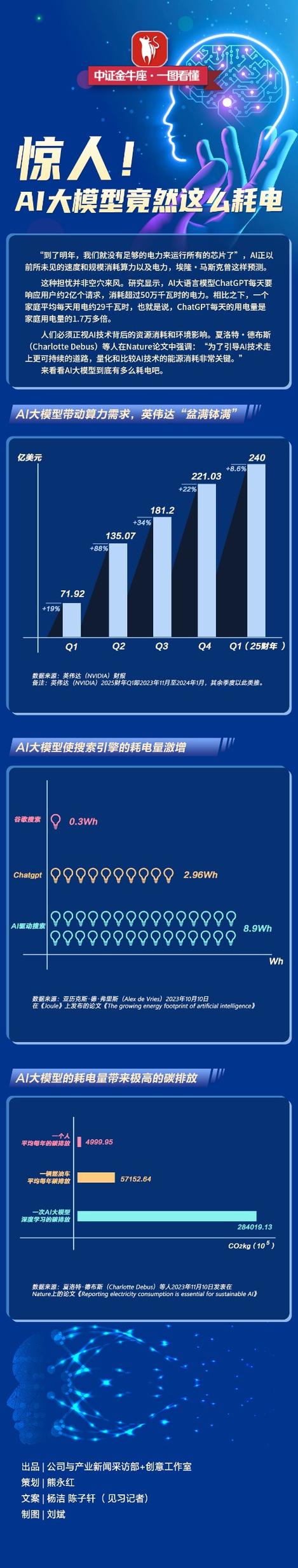

仅仅是GPT-4的GPU,一次演习就会用去2.4亿度电。AI为什么那么耗电?它们用掉的电都跑到哪里去了?有可能回收这些电转化成的能量吗?

撰文 | 猛犸

本日我们所说的人工智能(AI),紧张指的是天生式人工智能。而个中一大部分,是基于大措辞模型的天生式人工智能。

它们须要大规模的数据中央来演习和推理。这些数据中央由大量做事器组成,做事器花费的电能绝大部分转化成了热能,末了通过水冷系统开释出来。以是也可以说,AI的物理硬件是个巨大的“电热水器”。

这个说法听起来彷佛有点奇怪。我们都知道,做事器是一种电子打算机,而打算机中处理的是信息。信息和能量又有什么关系呢?

还真有。

处理信息须要花费能量

1961年,在IBM公司事情的物理学家拉尔夫·兰道尔(Rolf Landauer)揭橥了一篇论文,提出了后来被称为“兰道尔事理”(Landauer's Principle)的理论。这一理论认为,打算机中存储的信息发生不可逆的变革时,会向周围环境散发一点点热量,其散发的热量和打算机当时所处的温度有关——温度越高,散发的热量越多。

兰道尔事理连接起了信息和能量;更详细地说,连接到了热力学第二定律上。由于逻辑上不可逆的信息处理操作,也就意味着泯没了信息,这会导致物理天下中熵的增加,从而花费能量。

这一事理自提出以来遭受过不少质疑。但是近十几年来,兰道尔事理已被实验证明。2012年,《自然》杂志揭橥了一篇文章,研究团队首次丈量到了一“位”(bit)数据被删除时开释的微量热量。后来的几次独立实验,也都证明了兰道尔事理。

以是,处理信息是有能量本钱的。

现在的电子打算机在打算时实际花费的能量,是这个理论值的数亿倍。科学家们一贯在努力探求更高效的打算方法,以降落本钱。不过从目前的研究进展情形来看,大概只有真正的室温超导材料能广泛运用于打算设备时,这个能耗才有可能离兰道尔事理所描述的理论值近一些。

AI大模型确实须要大量打算。它的事情过程大致可以分为演习和推理两个阶段。在演习阶段,首先须要网络和预处理大量的文本数据,用作输入数据。然后在适当的模型架构中初始化模型参数,处理输入的数据,考试测验天生输出;再根据输出与预想之间的差异,反复调度参数,直到模型的性能不再显著提高为止。而在推理阶段中,则会先加载已经演习好的模型参数,预处理须要推理的文本数据,再让模型根据学习到的措辞规律天生输出。

无论是演习还是推理阶段,都是持续串信息重组过程,也同样遵照兰道尔事理。而我们也不难推知,模型的参数量越大,须要处理的数据越多,所需的打算量也就越大,所花费的能量也就越大,开释的热量也就越多。

只不过,这只是AI耗电中微不足道的一小部分。更大的花费来自另一个我们更熟习的物理定律:焦耳定律。这就要从集成电路提及了。

更“大头”能耗来自电流

本日的电子打算机建立在集成电路的根本上。我们常常把集成电路叫做芯片。每个芯片中,都有许多晶体管。

不严格地描述,晶体管可以理解成眇小的开关。这些开关串联或者并联在一起,就可以实现逻辑运算。“开”和“关”表示两种状态,也便是所谓的1和0,这便是打算的基本单位“位”。它是打算机二进制的根本。打算机通过快速改变电压,来拨动这些开关。

改变电压,须要电子流入或流出。而电子流入流出,就构成了电流。又由于在电路中总是有电阻,就产生了热能。焦耳定律见告我们,产生的热量与电流的平方成正比,与导体电阻成正比,与通电韶光成正比。

集成电路技能发展到本日,芯片中的晶体管已经变得极为眇小。以是,单个晶体管所产生的热量并不会太高。但问题是,芯片上的晶体管实在是已经多到了凡人无法想象的程度——比如,在IBM前几年发布的等效2纳米制程芯片中,每平方毫米面积上,均匀有3.3亿个晶体管。再小的热量,乘上这个规模,结果一定相称可不雅观。

一个可能让人大跌眼镜的有趣事实是,本日芯片单位体积的功率,比太阳核心多出好几个数量级。范例的CPU芯片功率大概是每立方厘米100瓦,即每立方米1亿瓦;而太阳核心的功率只有每立方米不到300瓦。

在OpenAI演习大措辞模型GPT-4时,完成一次演习须要约三个月韶光,利用大约25000块英伟达A100 GPU。每块A100 GPU都拥有540亿个晶体管,功耗400瓦,每秒钟可以进行19.5万亿次单精度浮点数的运算,每次运算又涉及到许多个晶体管的开关。

随意马虎算出,仅仅是这些 GPU,一次演习就用了2.4亿度电。这些电能险些全部转化成了热能,这些能量可以将大约200万立方米冰水——大概是1000个奥运会标准拍浮池的水量——加热到沸腾。

为什么AI须要用这么多的强大GPU来演习?由于大措辞模型的规模实在太大。GPT-3模型拥有1750亿参数,而据推测,GPT-4拥有1.8万亿参数,是GPT-3的十倍。要演习这种规模的模型,须要在大规模数据集上反复迭代,每一次迭代都须要打算和调度个中数十亿、数百亿乃至数千亿个参数的值,这些打算终极会表现为晶体管的开开关关,和集成电路中细细的电流——以及热量。

能量无法创造也无法消灭,它只能从一种形式转化成另一种形式。对付电子打算机来说,它最紧张的能量转化办法,便是从电能转化成热能。

大措辞模型也是如此。它对电能和冷却水的需求,正带来越来越严重的环境问题。

回收“电热水器”中的热量?

就在前几天,有微软公司的工程师说,为了演习GPT-6,微软和OpenAI建造了巨大的数据中央,将会利用10万块英伟达H100 GPU——性能比A100更强,当然功耗也更大——但是,这些GPU不能放在同一个州,否则会导致电网负荷过大而崩溃。

AI发展带来的能源短缺问题,已经开始浮现。在今年的达沃斯天下经济论坛上,OpenAI的CEO山姆·阿尔特曼(Sam Altman)认为,核聚变可能是能源的发展方向。但要开拓出真正可用的核聚变技能,可能还须要一些韶光。

水的问题也是一样。过去几年,那些在AI大模型领域先行一步的大企业们,都面临水花费大幅增长的局势。2023 年6月,微软公司发布了2022年度环境可持续发展报告,个顶用水一项,有超过20%的显著增长。谷歌公司也类似。

有研究者认为,AI的发展,是这些科技巨子用水量剧增的紧张缘故原由——要冷却猖獗发热的芯片,水冷系统是最常见的选择。为AI供应硬件根本的数据中央,如同一个巨大的“电热水器”。

如何让这些散失落的热能不至于白白摧残浪费蹂躏?最随意马虎想到也随意马虎实现的,是热回收技能。比方说,将数据中央回收的热量用于供应民用热水,冬季供应民用采暖。现在有一些企业已经动手在回收废热再利用了,例如中国移动哈尔滨数据中央、阿里巴巴千岛湖数据中央等。

这大概也算是一种解法,但并不能从根本上办理问题。AI家当的发展速率之快,在人类历史上没有任何家当能与之比较。平衡AI技能的发展与环境的可持续性,可能会是我们未来几年的主要议题之一;技能进步和能源花费之间的繁芜关系,从来没有这么急迫地涌如今人类面前。

本文受科普中国·星空操持项目扶持

出品:中国科协科普部

监制:中国科学技能出版社有限公司、北京中科星河文化传媒有限公司

特 别 提 示

1. 进入『返朴』微信公众号底部菜单“佳构专栏“,可查阅不同主题系列科普文章。

2. 『返朴』供应按月检索文章功能。关注公众年夜众号,回答四位数组成的年份+月份,如“1903”,可获取2019年3月的文章索引,以此类推。

版权解释:欢迎个人转发,任何形式的媒体或机构未经授权,不得转载和摘编。转载授权请在「返朴」微信"大众年夜众号内联系后台。